DoD Declara Anthropic um Risco Inaceitável à Segurança Nacional

Pontos principais

- DoD rotula Anthropic como um "risco inaceitável à segurança nacional"

- Preocupação centra-se na possível desabilitação ou alteração de modelos durante operações de guerra

- Anthropic assinou um contrato de US$ 200 milhões para incorporar IA em sistemas classificados

- Empresa se recusa a permitir o uso de sua IA para vigilância em massa e targeting de armas letais

- Anthropic alega violações da Primeira Emenda e punição retaliatória

- Especialistas legais chamam a justificativa do DoD de especulativa e sem apoio

- Empresas de tecnologia e grupos de direitos arquivaram breves amicus apoiando Anthropic

- Audiência sobre pedido de injunção preliminar agendada para a próxima semana

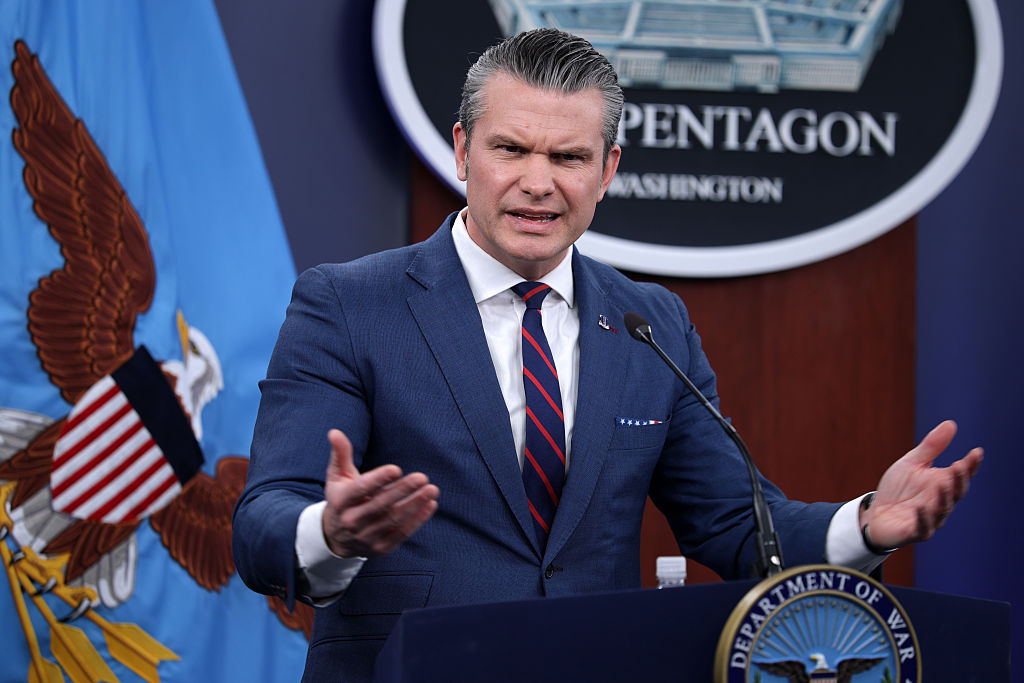

O Departamento de Defesa dos EUA rotulou o laboratório de IA Anthropic como um "risco inaceitável à segurança nacional", citando preocupações de que a empresa possa desabilitar ou alterar seus modelos durante operações de guerra se suas "linhas vermelhas" corporativas forem cruzadas. Anthropic, que assinou um contrato de US$ 200 milhões com o Pentágono no verão passado, processou para bloquear a designação de risco de cadeia de suprimentos do DoD, argumentando que a medida viola seus direitos da Primeira Emenda. Especialistas legais dizem que a justificativa do DoD se baseia em suposições especulativas, e numerous empresas de tecnologia e grupos de direitos arquivaram breves amicus apoiando Anthropic.

Contexto

O Departamento de Defesa anunciou que considera Anthropic, um laboratório de inteligência artificial, um "risco inaceitável à segurança nacional". A designação segue a decisão anterior do DoD de rotular a empresa como um risco de cadeia de suprimentos, uma medida que Anthropic contestou em um tribunal federal.

Argumento do DoD

Em um arquivo de 40 páginas, o DoD argumentou que Anthropic pode "tentar desabilitar sua tecnologia ou alterar antecipadamente o comportamento de seu modelo" antes ou durante operações de guerra se acredita que suas "linhas vermelhas" corporativas estão sendo cruzadas. A agência expressou preocupação de que tais ações possam comprometer sistemas críticos de missão.

Posição de Anthropic

Anthropic assinou um contrato de US$ 200 milhões com o Pentágono para integrar sua tecnologia em sistemas classificados. Durante as negociações do contrato, a empresa afirmou que não permitiria que sua IA fosse usada para vigilância em massa de americanos e afirmou que a tecnologia não estava pronta para decisões de targeting ou disparo envolvendo armas letais. Anthropic argumenta que a designação do DoD viola seus direitos da Primeira Emenda e equivale a retaliação punitiva por se recusar a concordar com uma cláusula de "uso legal".

Reação Legal e da Indústria

O analista legal Chris Mattei criticou a justificativa do DoD como especulativa, observando que nenhuma evidência foi apresentada para mostrar que Anthropic desabilitaria seus modelos em combate. Ele disse que o departamento não forneceu uma explicação credível para por que a recusa de Anthropic em aceitar certos termos a torna um risco de cadeia de suprimentos em vez de um fornecedor com o qual o DoD simplesmente não deseja trabalhar. Múltiplas empresas de tecnologia, incluindo OpenAI, Google e Microsoft, juntamente com grupos de direitos legais, arquivaram breves amicus apoiando Anthropic. Uma audiência sobre o pedido de Anthropic por uma injunção preliminar está agendada para a próxima semana.