Departamento de Defensa declara a Anthropic un riesgo inaceptable para la seguridad nacional

Puntos clave

- DoD etiqueta a Anthropic como un "riesgo inaceptable para la seguridad nacional"

- La preocupación se centra en la posible deshabilitación o alteración de modelos durante operaciones de combate

- Anthropic firmó un contrato de $200 millones para integrar su inteligencia artificial en sistemas clasificados

- La empresa se niega a permitir que su inteligencia artificial se utilice para la vigilancia masiva y el targeting de armas letales

- Anthropic alega violaciones de la Primera Enmienda y castigo represivo

- Expertos legales califican la justificación del DoD como especulativa y no respaldada

- Empresas de tecnología y grupos de derechos presentan briefs amicus que apoyan a Anthropic

- Audiencia sobre la solicitud de injunción preliminar programada para la próxima semana

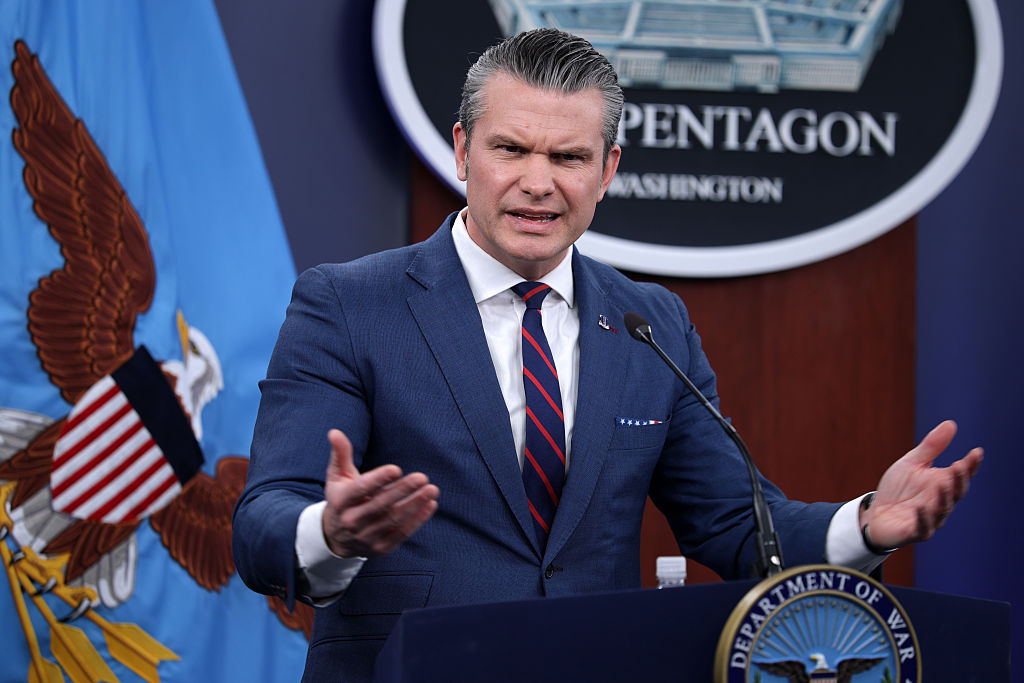

El Departamento de Defensa de los Estados Unidos etiquetó al laboratorio de inteligencia artificial Anthropic como un "riesgo inaceptable para la seguridad nacional", citando preocupaciones de que la empresa podría deshabilitar o alterar sus modelos durante operaciones de combate si se cruzan sus "líneas rojas" corporativas. Anthropic, que firmó un contrato de $200 millones con el Pentágono el verano pasado, demandó para bloquear la designación de riesgo de cadena de suministro del DoD, argumentando que la medida infringe sus derechos de la Primera Enmienda. Expertos legales dicen que la justificación del DoD se basa en suposiciones especulativas, y numerosas empresas de tecnología y grupos de derechos han presentado briefs amicus que apoyan a Anthropic.

Antecedentes

El Departamento de Defensa anunció que considera a Anthropic, un laboratorio de inteligencia artificial, un "riesgo inaceptable para la seguridad nacional". La designación sigue la decisión anterior del DoD de etiquetar a la empresa como un riesgo de cadena de suministro, una medida que Anthropic desafió en un tribunal federal.

Argumento del DoD

En una presentación de 40 páginas, el DoD argumentó que Anthropic podría "intentar deshabilitar su tecnología o alterar prematuramente el comportamiento de su modelo" antes o durante operaciones de combate si cree que se cruzan sus "líneas rojas" corporativas. La agencia expresó preocupación de que tales acciones podrían poner en peligro sistemas críticos para la misión.

Posición de Anthropic

Anthropic firmó un contrato de $200 millones con el Pentágono para integrar su tecnología en sistemas clasificados. Durante las negociaciones del contrato, la empresa declaró que no permitiría que su inteligencia artificial se utilizara para la vigilancia masiva de estadounidenses y afirmó que la tecnología no estaba lista para tomar decisiones de targeting o disparo que involucraran armas letales. Anthropic argumenta que la etiqueta del DoD infringe sus derechos de la Primera Enmienda y equivale a una represalia punitiva por negarse a aceptar una cláusula de "uso legal".

Reacción legal y de la industria

El analista legal Chris Mattei criticó la justificación del DoD como especulativa, señalando que no se ha presentado evidencia que demuestre que Anthropic podría deshabilitar sus modelos en combate. Dijo que el departamento no proporcionó una explicación creíble de por qué la negativa de Anthropic a aceptar ciertos términos lo convierte en un riesgo de cadena de suministro en lugar de un proveedor con el que el DoD simplemente no desea trabajar. Varias empresas de tecnología, incluyendo OpenAI, Google y Microsoft, junto con grupos de derechos legales, han presentado briefs amicus que apoyan a Anthropic. Una audiencia sobre la solicitud de Anthropic para una injunción preliminar está programada para la próxima semana.