Anthropic Garante 3,5 GW de Capacidade de TPU do Google via Broadcom, Receita Anualizada Supera US$ 30 Bilhões

Pontos principais

- Anthropic will access ~3.5 GW of Google TPU compute via Broadcom starting in 2027, adding to 1 GW for 2026.

- The agreement marks Anthropic's largest compute commitment and expands U.S. AI infrastructure under its $50 billion pledge.

- Broadcom acts as the silicon‑to‑workload layer and has a separate long‑term deal with Google for future TPU designs and networking through 2031.

- Anthropic’s revenue run‑rate has surpassed $30 billion, up from about $9 billion at the end of 2025.

- Series G funding raised $30 billion at a $380 billion valuation, boosting the customer base to over 1,000 enterprise users.

- Claude runs on Amazon Trainium, Google TPUs, and Nvidia GPUs, giving Anthropic a multi‑cloud hardware advantage.

- Broadcom shares rose roughly 3 % after the announcement; analysts project $21 billion in AI revenue from Anthropic in 2026.

- The deal reflects a broader compute arms race, with firms like SoftBank and Meta making similarly large infrastructure commitments.

Anthropic anunciou em 6 de abril que utilizará aproximadamente 3,5 gigawatts de capacidade de processamento de tensor de próxima geração do Google via Broadcom, começando em 2027, adicionando aos 1 GW já fornecidos para 2026. A medida apoia o compromisso da empresa de US$ 50 bilhões para expandir a infraestrutura de IA nos EUA e vem quando a empresa relata uma receita anualizada superior a US$ 30 bilhões - mais do que o triplo do valor no final de 2025.

Anthropic divulgou um acordo de computação multi-gigawatt que dará à empresa acesso a cerca de 3,5 GW de capacidade de processamento de tensor de próxima geração do Google via Broadcom, começando em 2027. O acordo, anunciado em 6 de abril, se baseia nos 1 GW de capacidade de TPU que a empresa já recebe para 2026 e marca o maior compromisso de infraestrutura na história da Anthropic.

O diretor financeiro Krishna Rao chamou a disposição de "nosso compromisso de computação mais significativo até o momento", enfatizando a abordagem disciplinada da empresa para escalar. A maior parte da nova capacidade será implantada nos EUA, extendendo o compromisso de novembro de 2025 da Anthropic de investir US$ 50 bilhões em infraestrutura de computação de IA nos EUA.

Papel Expansivo da Broadcom

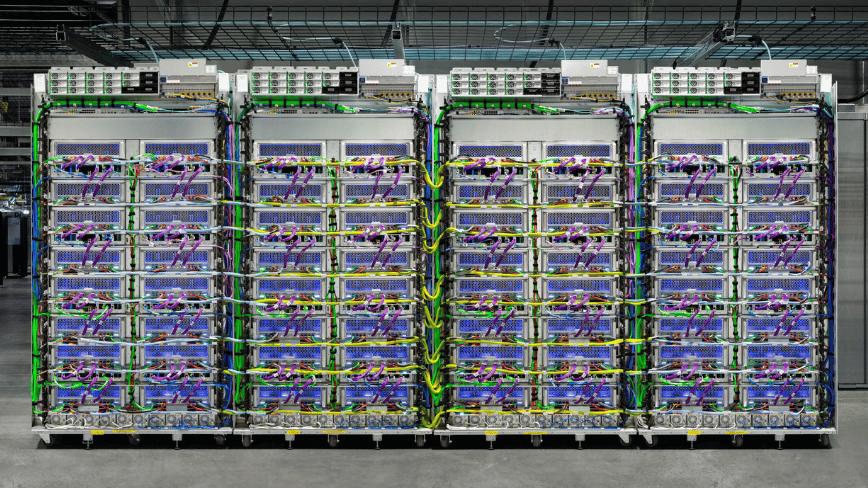

De acordo com o acordo, a Broadcom atua como intermediária entre o silício personalizado do Google e as cargas de trabalho de treinamento e inferência da Anthropic. O fabricante de chips também assinou um contrato de longo prazo separado com o Google para projetar chips de TPU futuros e fornecer componentes de rede e outros para os racks de dados de IA do Google até 2031. As ações da Broadcom subiram aproximadamente 3% em negociação após o anúncio, refletindo o interesse dos investidores em empresas que estão na camada física da pilha de IA.

Analistas da Mizuho projetaram que a Broadcom poderia gerar US$ 21 bilhões em receita de IA da Anthropic em 2026, subindo para US$ 42 bilhões em 2027. Esses números, embora especulativos, ilustram o peso financeiro do compromisso.

A participação da Broadcom remonta a setembro de 2025, quando um cliente misterioso fez um pedido de US$ 10 bilhões para racks de TPU personalizados - um acordo posteriormente confirmado como sendo com a Anthropic, seguido de um pedido adicional de US$ 11 bilhões em dezembro.

A expansão de computação da Anthropic coincide com um aumento dramático em seu desempenho comercial. A empresa relatou uma receita anualizada agora acima de US$ 30 bilhões, em comparação com aproximadamente US$ 9 bilhões no final de 2025. O salto segue uma rodada de financiamento da Série G em 12 de fevereiro de 2026, que arrecadou US$ 30 bilhões a uma valorização pós-dinheiro de US$ 380 bilhões. Na época, a Anthropic contava com mais de 500 clientes empresariais, cada um gastando mais de US$ 1 milhão anualmente; esse número desde então dobrou para exceder 1.000 clientes.

Claude, o modelo de bandeira da Anthropic, executa em uma estratégia de hardware multi-fornecedor que inclui chips Trainium da Amazon, TPUs do Google e GPUs da Nvidia. O modelo é o único sistema de IA de fronteira disponível em Amazon Web Services, Google Cloud e Microsoft Azure, dando à Anthropic alavancagem de negociação e resiliência contra choques de fornecimento.

A Amazon permanece como uma parceira fundamental. No final de 2024, a Anthropic nomeou a AWS como sua principal provedora de nuvem e treinamento, com a Amazon comprometendo US$ 8 bilhões com a relação. O projeto Rainier, um cluster de supercomputador da Anthropic em Indiana, opera aproximadamente 500.000 chips Trainium 2 e está programado para ultrapassar um milhão de chips até o final de 2025.

O foco nos EUA da nova capacidade alinha-se com o Plano de Ação de IA da administração Trump, que prioriza recursos de computação domésticos. O compromisso de infraestrutura de US$ 50 bilhões da Anthropic, inicialmente construído com a Fluidstack do Reino Unido para sites de data centers no Texas e em Nova York, verá a maior parte da capacidade de TPU fornecida pela Broadcom adicionada até 2027.

O acordo é um ponto de dados claro na corrida armamentista de computação mais ampla que viu a SoftBank comprometer US$ 40 bilhões para apoiar a OpenAI e a Meta assinar um acordo de infraestrutura de US$ 27 bilhões com a Nebius. À medida que os modelos de IA se tornam mais exigentes, laboratórios como a Anthropic são forçados a garantir financiamento e parcerias que se assemelham a projetos de escala de utilidade.

Para a Broadcom, a parceria cimenta seu status como um elemento de carga da pilha de infraestrutura de IA, posicionando-a ao lado de gigantes da indústria como a Nvidia, que continua a dominar os mercados de aceleradores.