OpenAI Apoia Projeto de Lei de Illinois para Proteger Laboratórios de IA de Responsabilidade por Danos em Massa

Pontos principais

- OpenAI testified in support of Illinois SB 3444, which would limit liability for AI labs in cases of mass casualties or $1 billion‑plus property loss.

- The bill defines a "frontier model" as any AI system trained with over $100 million in compute costs, covering major players like OpenAI, Google, xAI, Anthropic and Meta.

- To qualify for protection, labs must not act intentionally or recklessly and must publish safety, security and transparency reports on their websites.

- OpenAI spokesperson Jamie Radice said the measure avoids a patchwork of state regulations and promotes consistent national standards.

- Critics, including policy director Scott Wisor, argue the bill could reduce accountability and note strong public opposition in Illinois.

- Illinois has previously passed AI‑related laws, such as restrictions on AI use in mental‑health services and the Biometric Information Privacy Act.

- Federal AI liability legislation remains absent, leaving states to craft varied approaches that could impact industry innovation.

OpenAI testemunhou a favor do Projeto de Lei do Senado de Illinois 3444, que protegeria os desenvolvedores de modelos de IA de ponta de responsabilidade civil por "danos críticos" como mortes em massa ou danos à propriedade de mais de US$ 1 bilhão, desde que publiquem relatórios de segurança e evitem conduta negligente. A legislação define um modelo de ponta como um treinado com mais de US$ 100 milhões em custos de computação e visa criar padrões uniformes enquanto limita remendos regulatórios estaduais. Críticos alertam que o projeto de lei pode reduzir a responsabilidade, mas OpenAI argumenta que equilibra segurança e inovação.

Chicago – OpenAI entrou no palco legislativo em 9 de abril, testemunhando a favor do Projeto de Lei do Senado de Illinois 3444, uma proposta que proibiria laboratórios de IA de serem processados por "danos críticos" causados por seus modelos mais avançados. O projeto de lei visa incidentes que resultem em 100 ou mais mortes, lesões ou pelo menos US$ 1 bilhão em perdas de propriedade, desde que o laboratório não tenha agido intencionalmente ou negligentemente e tenha publicado relatórios de segurança, segurança e transparência online.

A legislação define um "modelo de ponta" como qualquer sistema de IA treinado com mais de US$ 100 milhões em custos de computação. Essa definição captura os principais jogadores da indústria – OpenAI, Google, xAI, Anthropic e Meta – cujos modelos rotineiramente ultrapassam esse limite.

"Apoiamos abordagens como essa porque se concentram no que mais importa: Reduzir o risco de danos graves dos sistemas de IA mais avançados, enquanto ainda permite que essa tecnologia seja colocada nas mãos das pessoas e empresas – pequenas e grandes – de Illinois," disse o porta-voz da OpenAI, Jamie Radice, em um comunicado por e-mail. "Eles também ajudam a evitar um patchwork de regras estaduais e a mover em direção a padrões nacionais mais claros e consistentes."

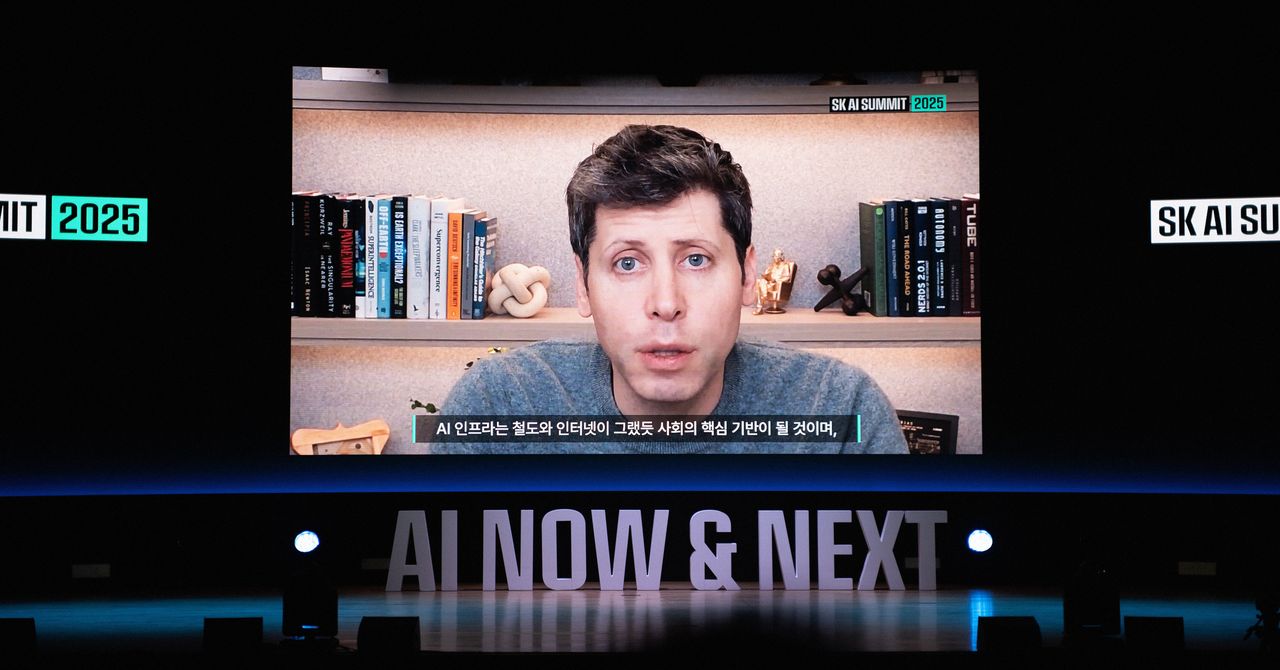

A representante de assuntos globais da OpenAI, Caitlin Niedermeyer, que testemunhou perante o comitê do Senado, ecoou a posição da empresa sobre a harmonização federal. Ela alertou que um cenário fragmentado de regulamentações estaduais pode criar atrito sem melhorar a segurança e instou o Congresso a adotar um quadro unificado que "reforçaria um caminho em direção à harmonização com os sistemas federais."

Críticos permanecem céticos. Scott Wisor, diretor de políticas do projeto Secure AI, disse à WIRED que o projeto de lei enfrenta chances slim de aprovação, observando que uma recente pesquisa em Illinois mostrou que 90% dos residentes se opõem a isentar empresas de IA de responsabilidade. Ele acrescentou que o estado já perseguiu regras de IA mais rigorosas, como limitar o uso de IA em serviços de saúde mental e aplicar a Lei de Privacidade de Informações Biométricas.

O SB 3444 lista vários cenários que se qualificam como danos críticos, incluindo a criação de armas químicas, biológicas, radiológicas ou nucleares por um ator mal-intencionado usando IA, e conduta autônoma de IA que seria criminosa se realizada por um humano. De acordo com o projeto de lei, um laboratório escaparia de responsabilidade se não tivesse causado intencionalmente ou negligentemente o resultado e tivesse cumprido com os requisitos de relatórios.

Legisladores federais ainda não aprovaram nenhum quadro de responsabilidade específico de IA, deixando os estados para experimentar suas próprias abordagens. Illinois se junta à Califórnia e a Nova York, que promulgaram projetos de lei que exigem que os desenvolvedores de IA submetam relatórios de segurança e transparência. A falta de um padrão nacional deixa as empresas navegando em um patchwork de regulamentações que podem impedir a inovação.

Apoio da OpenAI marca uma mudança em sua postura defensiva anterior, onde a empresa se opôs a medidas que pudessem expô-la a processos judiciais sobre sua tecnologia. A empresa agora parece favorecer a legislação que acredita proteger tanto a segurança pública quanto a vantagem competitiva da pesquisa de IA dos EUA.

Membros da família de crianças que morreram por suicídio após formar relações insalubres com o ChatGPT entraram com processos judiciais contra a OpenAI, destacando os danos pessoais que também atraem escrutínio. Embora o SB 3444 se concentre em eventos em larga escala, o debate mais amplo continua sobre como abordar tanto os riscos individuais quanto sociais impostos por modelos de IA cada vez mais poderosos.

À medida que a indústria observa a tentativa de Illinois, o resultado pode estabelecer um precedente para como os EUA equilibram responsabilidade com avanço rápido de IA.