OpenAI Apoya Proyecto de Ley de Illinois para Proteger a Laboratorios de IA de Responsabilidad por Daños Masivos

Puntos clave

- OpenAI testified in support of Illinois SB 3444, which would limit liability for AI labs in cases of mass casualties or $1 billion‑plus property loss.

- The bill defines a "frontier model" as any AI system trained with over $100 million in compute costs, covering major players like OpenAI, Google, xAI, Anthropic and Meta.

- To qualify for protection, labs must not act intentionally or recklessly and must publish safety, security and transparency reports on their websites.

- OpenAI spokesperson Jamie Radice said the measure avoids a patchwork of state regulations and promotes consistent national standards.

- Critics, including policy director Scott Wisor, argue the bill could reduce accountability and note strong public opposition in Illinois.

- Illinois has previously passed AI‑related laws, such as restrictions on AI use in mental‑health services and the Biometric Information Privacy Act.

- Federal AI liability legislation remains absent, leaving states to craft varied approaches that could impact industry innovation.

OpenAI testificó a favor del Proyecto de Ley del Senado de Illinois 3444, que protegería a los desarrolladores de modelos de IA de vanguardia de la responsabilidad civil por "daños críticos" como muertes masivas o daños a la propiedad de más de mil millones de dólares, siempre y cuando publiquen informes de seguridad y eviten conductas imprudentes. La legislación define un modelo de vanguardia como aquel entrenado con más de $100 millones en costos de cómputo y busca crear estándares uniformes mientras limita las regulaciones estatales

Chicago – OpenAI dio un paso hacia la escena legislativa el 9 de abril, testificando a favor del Proyecto de Ley del Senado de Illinois 3444, una propuesta que prohibiría a los laboratorios de IA ser demandados por "daños críticos" causados por sus modelos más avanzados. El proyecto de ley se centra en incidentes que resulten en 100 o más muertes, lesiones o al menos $1 mil millones en pérdidas de propiedad, siempre y cuando el laboratorio no haya actuado intencionalmente o imprudentemente y haya publicado informes de seguridad, seguridad y transparencia en línea.

La legislación define un "modelo de vanguardia" como cualquier sistema de IA entrenado con más de $100 millones en costos de cómputo. Esa definición abarca a los principales actores de la industria – OpenAI, Google, xAI, Anthropic y Meta – cuyos modelos rutinariamente superan ese umbral.

"Apoyamos enfoques como este porque se centran en lo que más importa: reducir el riesgo de daños graves de los sistemas de IA más avanzados mientras aún permiten que esta tecnología llegue a las manos de las personas y empresas – pequeñas y grandes – de Illinois", dijo el portavoz de OpenAI, Jamie Radice, en un comunicado por correo electrónico. "También ayudan a evitar un patchwork de reglas estatales y a avanzar hacia estándares nacionales más claros y consistentes".

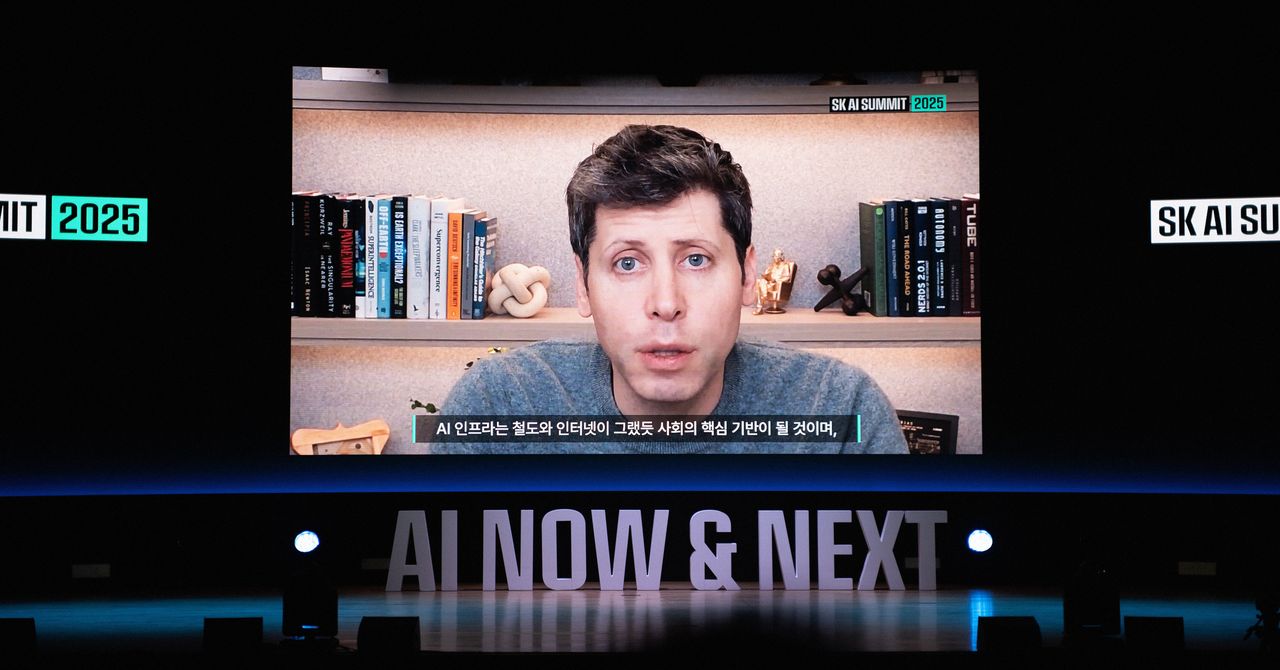

La representante de asuntos globales de OpenAI, Caitlin Niedermeyer, quien testificó ante el comité del Senado, hizo eco de la postura de la empresa sobre la armonización federal. Advirtió que un paisaje fragmentado de regulaciones estatales podría crear fricción sin mejorar la seguridad, y urgió al Congreso a adoptar un marco unificado que "refuerce un camino hacia la armonización con los sistemas federales".

Los críticos siguen siendo escépticos. Scott Wisor, director de políticas del proyecto Secure AI, le dijo a WIRED que el proyecto de ley enfrenta probabilidades escasas de aprobación, señalando que una encuesta reciente en Illinois mostró que el 90 por ciento de los residentes se oponen a eximir a las empresas de IA de la responsabilidad. Agregó que el estado ya ha perseguido reglas de IA más estrictas, como limitar el uso de IA en servicios de salud mental y hacer cumplir la Ley de Privacidad de Información Biométrica.

El SB 3444 enumera varios escenarios que califican como daños críticos, incluida la creación de armas químicas, biológicas, radiológicas o nucleares por un actor malicioso que utiliza IA, y la conducta autónoma de IA que sería criminal si la realizará un ser humano. Bajo el proyecto de ley, un laboratorio escaparía de la responsabilidad si no hubiera causado intencionalmente o imprudentemente el resultado y hubiera cumplido con los requisitos de informes.

Los legisladores federales aún no han aprobado ningún marco de responsabilidad específico de IA, lo que deja a los estados experimentar con sus propios enfoques. Illinois se une a California y Nueva York, que han promulgado proyectos de ley que requieren que los desarrolladores de IA presenten informes de seguridad y transparencia. La falta de un estándar nacional deja a las empresas navegando por un patchwork de regulaciones que podrían obstaculizar la innovación.

El apoyo de OpenAI marca un cambio en su postura defensiva anterior, donde la empresa se opuso a medidas que podrían exponerla a demandas sobre su tecnología. La empresa ahora parece favorecer la legislación que cree que protegerá tanto la seguridad pública como la ventaja competitiva de la investigación de IA de EE. UU.

Los miembros de la familia de niños que murieron por suicidio después de formar supuestamente relaciones poco saludables con ChatGPT han presentado demandas contra OpenAI, destacando los daños personales que también atraen escrutinio. Si bien el SB 3444 se centra en eventos a gran escala, el debate más amplio continúa sobre cómo abordar tanto los riesgos individuales como los sociales que plantean los modelos de IA cada vez más poderosos.

Como la industria observa el esfuerzo de Illinois, el resultado podría sentar un precedente para cómo EE. UU. equilibra la rendición de cuentas con el avance rápido de la IA.