Google, Microsoft e xAI Concordam em Dar ao Governo dos EUA Acesso Antecipado a Modelos de IA

Pontos principais

- Google, Microsoft e xAI assinaram contratos para fornecer acesso antecipado a modelos de IA ao Departamento de Comércio dos EUA.

- O Centro de Padrões e Inovação em IA avaliará os modelos com salvaguardas reduzidas ou desabilitadas.

- Os acordos visam avaliar riscos de segurança nacional, como geração de desinformação e potencial armamentização.

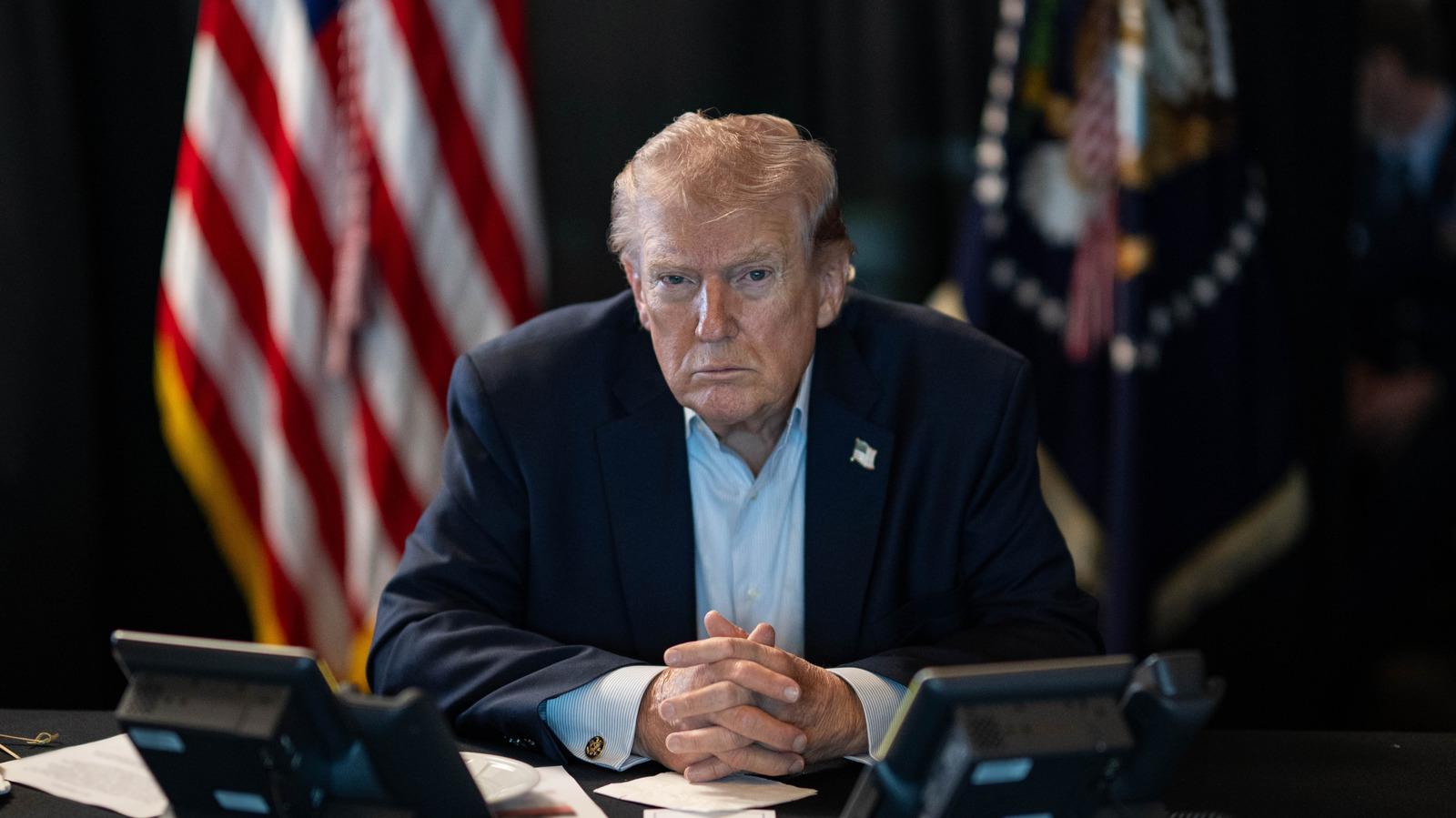

- Os acordos seguem relatos de que a administração Trump está considerando uma supervisão mais rigorosa da IA e um grupo de trabalho de revisão.

- A cooperação da indústria pode ajudar as empresas a evitar serem rotuladas como riscos de cadeia de suprimentos, como a Anthropic enfrentou anteriormente.

- Críticos temem que salvaguardas enfraquecidas possam expor vulnerabilidades, enquanto defensores enfatizam a necessidade de medição rigorosa.

Google, Microsoft e xAI, de Elon Musk, assinaram acordos que permitem ao Centro de Padrões e Inovação em IA do Departamento de Comércio avaliar seus sistemas de inteligência artificial de próxima geração antes de serem lançados publicamente. Os acordos, anunciados um dia após relatos de que a administração Trump estava considerando uma supervisão mais rigorosa da IA, estabelecem que as empresas forneçam modelos com salvaguardas reduzidas ou desabilitadas para que analistas federais possam investigar riscos de segurança nacional. O diretor do CAISI, Chris Fall, disse que as colaborações expandirão a capacidade do governo de medir a IA de fronteira e proteger os interesses dos EUA.

Em uma medida que pode redefinir como os EUA monitoram a tecnologia de inteligência artificial emergente, Google, Microsoft e xAI assinaram contratos para fornecer versões antecipadas de seus modelos de IA ao Centro de Padrões e Inovação em IA do Departamento de Comércio (CAISI). Os acordos, divulgados em 5 de maio, dão aos analistas federais a chance de examinar sistemas de ponta antes de chegarem ao mercado.

O CAISI, a agência responsável por desenvolver padrões de medição para IA avançada, receberá os modelos com salvaguardas reduzidas ou, em alguns casos, salvaguardas desabilitadas. Esse nível de acesso permite que o departamento teste os sistemas para capacidades que possam afetar a segurança nacional, desde análise de dados sofisticada até potencial armamentização.

"A ciência de medição independente e rigorosa é essencial para entender a IA de fronteira e suas implicações de segurança nacional", disse o diretor do CAISI, Chris Fall, ao The Wall Street Journal. "Essas colaborações industriais expandidas nos ajudam a ampliar nosso trabalho no interesse público em um momento crítico." A declaração destaca a pressão da administração para manter o ritmo dos avanços rápidos da IA que podem ultrapassar os quadros regulatórios existentes.

O timing dos acordos é notável. Um dia antes, The New York Times relatou que a administração Trump estava considerando se deveria tighten a supervisão da indústria de IA. A Casa Branca havia considerado um grupo de trabalho com poder de revisar novos modelos antes de serem lançados publicamente, uma mudança em relação à abordagem mais flexível delineada no Plano de Ação de IA do presidente.

Insiders da indústria dizem que os contratos são uma resposta pragmática à pressão crescente. Empresas que resistem a fornecer acesso irrestrito arriscam ser rotuladas como riscos de cadeia de suprimentos, como aconteceu com a Anthropic após o Pentágono levantar preocupações sobre as salvaguardas da empresa contra a vigilância em massa e armas autônomas. Ao cooperar, Google, Microsoft e xAI evitam potenciais listas negras e demonstram conformidade com as expectativas federais.

De acordo com os acordos, as três empresas fornecerão seus modelos mais recentes ao CAISI para testes. A agência avaliará os sistemas para uma variedade de atributos relacionados à segurança, incluindo a capacidade de gerar desinformação, evadir detecção ou ser reutilizada para aplicações militares. As avaliações informarão diretrizes que podem moldar decisões de compra futuras em toda a administração federal.

Críticos da abordagem alertam que conceder ao governo acesso a modelos de IA com salvaguardas enfraquecidas pode expor vulnerabilidades ou criar um precedente para uma vigilância mais ampla. Defensores argumentam que, sem essa transparência, os EUA podem ficar para trás dos rivais na compreensão das ameaças impostas pela IA de fronteira.

Embora os acordos sinalizem uma postura mais colaborativa entre o setor de tecnologia e o governo federal, eles também levantam questões sobre o equilíbrio entre inovação e segurança. As próximas etapas da administração — potencialmente formalizando um grupo de trabalho com autoridade de revisão — determinarão até que ponto o regime de supervisão se estende.

Por enquanto, os três gigantes da tecnologia parecem dispostos a colocar seus modelos mais avançados sob escrutínio do governo, uma decisão que pode definir o tom para futuras parcerias entre a indústria e o governo na área de IA.