Administração Trump Propõe Estrutura Federal de IA que Precede Leis Estaduais

Pontos principais

- Estrutura federal de IA busca um padrão nacional único, precedendo leis estaduais de IA.

- Sete objetivos focam na inovação, escalonamento e abordagem regulatória leve.

- Autoridade estadual limitada a leis gerais; desenvolvimento de IA considerado questão interestadual.

- Responsabilidade pela segurança infantil transferida para os pais; Congresso instado a exigir salvaguardas de plataforma.

- Proposta de escudo de responsabilidade para desenvolvedores contra penalidades estaduais por condutas ilegais de terceiros.

- Estrutura carece de mecanismos claros de execução e supervisão independente.

- Indústria elogia padrões uniformes; críticos alertam que isso limita a experimentação estadual.

- Ordem executiva anterior dirigiu agências a questionar regulamentações estaduais de IA "onerosas"

A administração Trump apresentou uma estrutura legislativa visando criar uma política nacional única de IA. O plano centralizaria a autoridade em Washington, precedendo as regulamentações estaduais de IA, enquanto enfatiza uma abordagem leve e focada na inovação.

Iniciativa Federal para Padronizar a Política de IA

A administração Trump anunciou uma estrutura legislativa destinada a estabelecer uma política única de IA para os Estados Unidos. De acordo com um comunicado da Casa Branca, uma abordagem nacional uniforme é essencial porque um mosaico de leis estaduais conflitantes minaria a inovação americana e a capacidade da nação de liderar na corrida global de IA.

Objetivos Principais e Foco na Inovação

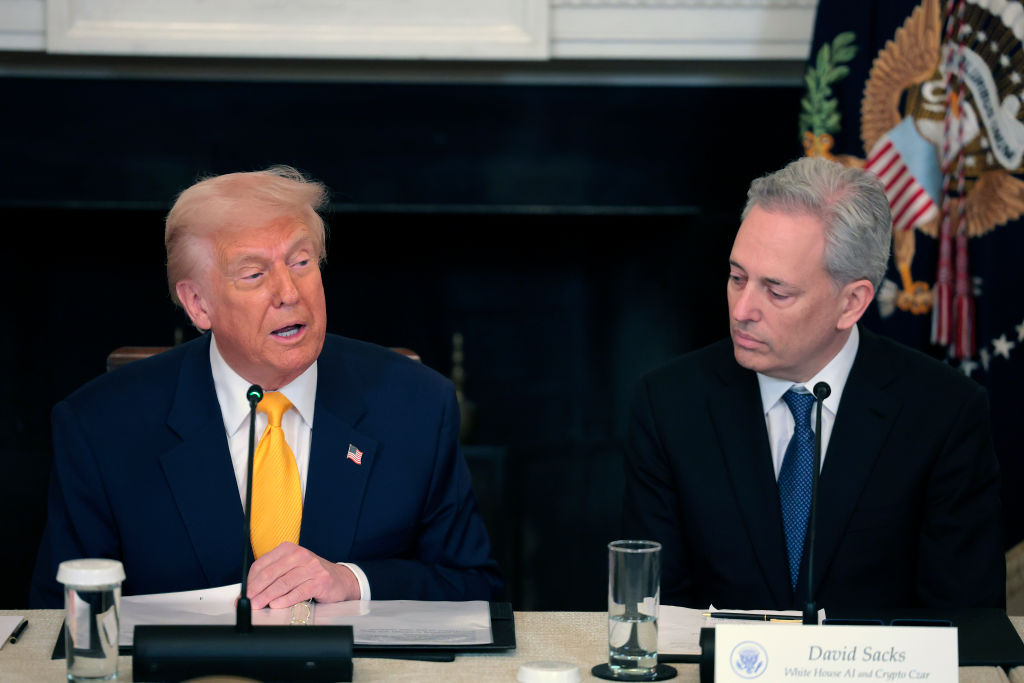

A estrutura estabelece sete objetivos principais que priorizam a inovação e o escalonamento das tecnologias de IA. Propõe um padrão nacional centralizado e "minimamente oneroso" que substituiria regulamentações estaduais mais rigorosas. Essa abordagem alinha-se com a postura mais ampla da administração para remover barreiras à inovação, uma posição defendida pelo czar de IA da Casa Branca e venture-capitalista David Sacks.

Precedência da Autoridade Estadual

De acordo com a proposta, a autoridade estadual seria limitada a leis gerais, como fraude, proteção infantil, zoneamento e uso de IA por agências estaduais. A estrutura afirma explicitamente que o desenvolvimento de IA é uma questão "inherentemente interestadual" ligada à segurança nacional e política externa, e, portanto, não deve ser regulamentado por estados individuais. Além disso, fornece um escudo de responsabilidade para os desenvolvedores, impedindo que os estados os penalizem por condutas ilegais de terceiros envolvendo seus modelos.

Responsabilidade dos Pais e Segurança Infantil

O plano coloca uma grande responsabilidade pela segurança infantil nos pais, em vez de nas plataformas. Solicita ao Congresso que exija das empresas de IA implementar recursos que "reduzam os riscos de exploração sexual e danos a menores", mas não define requisitos concretos e executáveis. A estrutura sugere ferramentas como controles de conta para ajudar os pais a proteger a privacidade de seus filhos e gerenciar o uso de dispositivos.

Direito Autoral e Moderação de Conteúdo

Em relação à propriedade intelectual, a estrutura busca um meio-termo citando o "uso justo" como justificativa para treinar IA em obras existentes. Na área de moderação de conteúdo, a proposta se concentra em prevenir a censura impulsionada pelo governo, em vez de impor salvaguardas de nível de plataforma. Insta o Congresso a impedir que o governo coaja os provedores de IA a banir ou alterar conteúdo com base em "agendas partidárias ou ideológicas" e a fornecer reparos legais para os americanos afetados.

Críticas e Reação da Indústria

Críticos argumentam que a estrutura reduz o espaço para os estados atuarem como reguladores precoces e carece de mecanismos claros para supervisão, responsabilidade ou execução de danos novos. Eles apontam para iniciativas estaduais como a Lei RAISE de Nova York e a SB-53 da Califórnia, que visam garantir que grandes empresas de IA adotem protocolos de segurança documentados publicamente. Brendan Steinhauser, CEO da Aliança para IA Segura, acusou a proposta de servir aos interesses da grande tecnologia em detrimento dos americanos comuns.

Por outro lado, figuras da indústria elogiaram a medida. Teresa Carlson, presidente do Instituto General Catalyst, disse que a estrutura oferece às startups um padrão nacional claro que permite a construção e escalonamento rápidos sem navegar por um mosaico de leis estaduais.

Contexto e Batalhas Legais em Curso

A estrutura segue uma ordem executiva assinada três meses antes que dirigiu agências federais a questionar leis estaduais de IA e deu ao Departamento de Comércio 90 dias para compilar uma lista de regulamentações estaduais "onerosas", lista que ainda não foi publicada. A ordem também instruiu a administração a trabalhar com o Congresso em uma lei de IA uniforme. Enquanto isso, a empresa de IA Anthropic processa o governo sobre uma designação do Departamento de Defesa como risco de cadeia de suprimentos, alegando violação dos direitos da Primeira Emenda. O presidente Trump rotulou publicamente o CEO da Anthropic, Dario Amodei, como "acordado" e "esquerdista radical".

Implicações Potenciais

Se aprovada, a estrutura centralizaria a elaboração de políticas de IA em Washington, limitaria a experimentação estadual e transferiria grande parte da responsabilidade pela segurança infantil para os pais. Embora a indústria acolha a perspectiva de um padrão nacional claro, defensores de proteções mais fortes ao consumidor e inovação em nível estadual alertam que a proposta pode deixar lacunas significativas na supervisão, responsabilidade e execução.