Tu cerebro puede detectar voces de IA incluso cuando tú no puedes

Puntos clave

- Los oyentes lucharon para distinguir conscientemente el habla real de la habla generada por IA.

- Los registros de EEG mostraron respuestas neuronales distintas dentro de milisegundos de escuchar cada voz.

- Tres picos de respuesta neural aparecieron alrededor de 55 ms, 210 ms y 455 ms después del inicio del estímulo.

- El análisis acústico identificó diferencias en el rango de modulación de 5,4-11,7 Hz entre el habla real y la sintética.

- La detección temprana del cerebro ocurre antes de que se tome cualquier decisión consciente.

- Los hallazgos sugieren un potencial para programas de capacitación que alineen las señales neuronales con la conciencia.

- La investigación destaca una brecha entre la percepción inconsciente y el juicio consciente del audio deepfake.

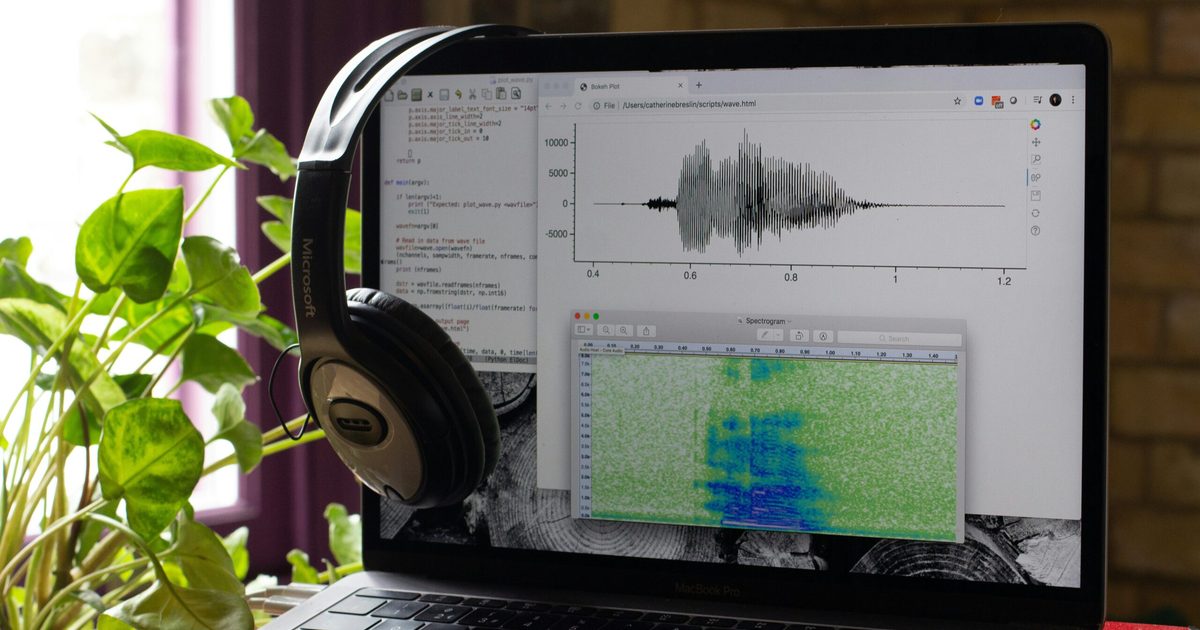

Investigadores de la Universidad de Tianjin y la Universidad China de Hong Kong encontraron que, aunque los oyentes a menudo no pueden distinguir conscientemente el habla humana real de las voces sintéticas de IA, su cerebro comienza a etiquetar las diferencias acústicas sutiles después de una breve exposición. Utilizando cascos EEG, el estudio reveló respuestas neuronales tempranas que separan el habla real y la de IA dentro de milisegundos, destacando una brecha entre la percepción inconsciente y la toma de decisiones consciente. Los hallazgos sugieren que el sistema auditivo ya está adaptándose a las voces generadas por IA, lo que ofrece esperanza para futuras herramientas que podrían ayudar a las personas a traducir estas señales neuronales en una detección confiable de audio deepfake.

Descripción del estudio

Científicos de la Universidad de Tianjin y la Universidad China de Hong Kong probaron a un grupo de oyentes sobre su capacidad para distinguir el habla humana real de la habla generada por IA. Los participantes fueron solicitados a presionar un botón que indicara si cada voz era real o falsa. La prueba incluyó oraciones dichas por personas reales, habla sintética básica y una voz de IA más refinada que sonaba muy natural.

Rendimiento consciente

A pesar de la capacitación breve diseñada para mejorar la detección, los oyentes lucharon consistentemente para tomar decisiones correctas. La mayoría de las respuestas fueron incorrectas, lo que muestra que la percepción consciente sola era insuficiente para la identificación confiable de voces clonadas de IA.

Hallazgos neuronales

Mientras que los participantes realizaron mal, los cascos EEG grabaron su actividad cerebral durante todo el experimento. Después de solo doce minutos de capacitación, comenzaron a emerger patrones neuronales distintos. El cerebro mostró tres picos de respuesta separados - alrededor de cincuenta y cinco milisegundos, doscientos diez milisegundos y cuatrocientos cincuenta y cinco milisegundos después de escuchar cada voz. Estas señales de etapa temprana ocurrieron mucho antes de que se tomara cualquier decisión consciente, lo que indica que el sistema auditivo estaba procesando silenciosamente las diferencias sutiles entre el habla real y la sintética.

Diferencias acústicas

Un análisis acústico adicional reveló que el habla real y la de IA difirieron en el rango de modulación de 5,4 a 11,7 Hz, una banda de frecuencia vinculada a cómo el cerebro rastrea los detalles rápidos del habla, como fonemas y comienzos de sílabas. Incluso las voces de IA que sonaban más naturales no replicaron perfectamente estas microvariaciones, lo que proporcionó una base física para la detección temprana del cerebro.

Implicaciones

La investigación sugiere que los humanos no están indefensos ante el fraude de clonación de voces. El hardware del cerebro ya es capaz de reconocer señales de alerta sutiles, pero la mente consciente aún no ha conectado esas señales de alerta con la noción de "falso". Los programas de capacitación futuros podrían cerrar esta brecha enseñando a los oyentes a centrarse en las huellas digitales acústicas específicas que su sistema auditivo ya detecta. Esta educación dirigida podría mejorar la conciencia pública y la resistencia contra las amenazas de audio deepfake.

Conclusión

En general, el estudio demuestra una desconexión clara entre el procesamiento neural inconsciente y el juicio consciente cuando se trata del habla generada por IA. Mientras que la mente consciente puede ser engañada, el cerebro está haciendo silenciosamente su tarea, sentando las bases para herramientas de detección más efectivas y métodos de capacitación en el futuro.