La automatización de tareas de Google Gemini muestra promesa a pesar de los problemas iniciales

Puntos clave

- Gemini puede controlar aplicaciones de teléfono para realizar pedidos de comida y programar viajes.

- La función beta se ejecuta en segundo plano y muestra actualizaciones de estado en pantalla.

- Se requiere la confirmación del usuario antes de finalizar el pedido o viaje.

- El rendimiento es más lento que el de un ser humano, con pausas ocasionales para permisos.

- La precisión es generalmente alta, con solo ajustes menores necesarios.

- Las pruebas incluyeron pedir un combo de teriyaki de pollo y programar un viaje al aeropuerto.

- Los diseños de aplicaciones actuales no están optimizados para la interacción con la inteligencia artificial.

- Google sugiere que los desarrolladores adopten el Protocolo de Contexto de Modelo o las funciones de la aplicación de Android.

- La industria ve esta función como una visión previa de los asistentes móviles más capaces impulsados por la inteligencia artificial.

El AI de Google, Gemini, puede controlar aplicaciones de teléfono para realizar pedidos de comida y programar viajes, pero la función beta se siente lenta y sometimes torpe. Funciona en segundo plano, requiere confirmación del usuario antes de finalizar acciones y ocasionalmente se detiene en permisos o solicitudes de ubicación. Aunque la precisión es a menudo alta, la experiencia destaca la necesidad de diseños de aplicaciones que se adapten mejor a los agentes de inteligencia artificial. Los expertos de la industria ven esto como una visión previa de los asistentes móviles del futuro, con desarrolladores instados a adoptar métodos de integración más nuevos como el Protocolo de Contexto de Modelo.

Visión general de la automatización de tareas de Gemini

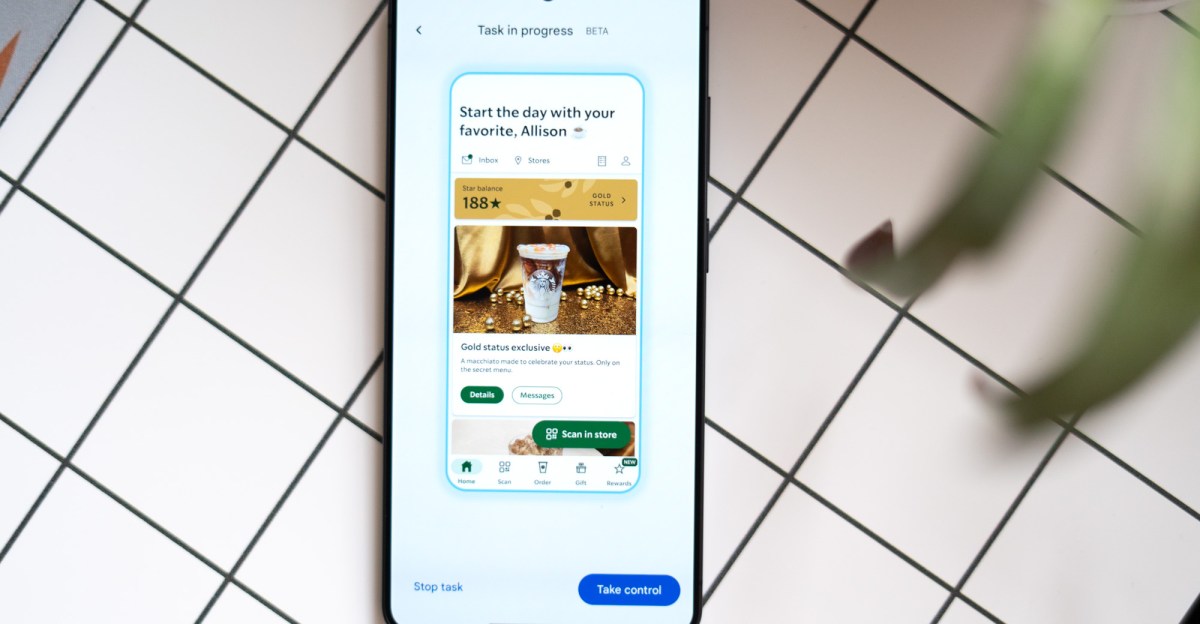

Google ha introducido una versión beta de la automatización de tareas para su AI Gemini en dispositivos Android. La función permite que Gemini interactúe directamente con aplicaciones como servicios de entrega de comida y viajes compartidos, realizando acciones en nombre del usuario mientras el teléfono se utiliza para otras tareas.

Cómo funciona la función

Cuando un usuario inicia una automatización, Gemini opera en segundo plano. Una pequeña barra de texto aparece en la parte inferior de la pantalla describiendo el paso actual, por ejemplo, cuando se seleccionan elementos del menú en una aplicación de pedido de comida. El AI procede a través de la interfaz de la aplicación —haciendo clic, desplazándose y ingresando información— hasta que llega a la pantalla de confirmación final, donde el usuario debe aprobar manualmente el pedido o viaje.

Rendimiento y experiencia del usuario

Las pruebas iniciales muestran que Gemini es notablemente más lento que un ser humano realizando las mismas acciones. Los usuarios informaron que un pedido simple de Uber puede tomar varios minutos, y el AI sometimes hace selecciones incorrectas que luego corrige por sí mismo. El sistema también puede pausar cuando una aplicación requiere permisos adicionales, como acceso a la ubicación, o cuando se necesita ajustar la dirección de entrega. Después de resolver el problema, la automatización se puede reiniciar sin problemas.

Precisión y confiabilidad

A pesar del ritmo más lento, las salidas finales del AI suelen ser precisas. En la mayoría de los casos, solo se necesitan ajustes menores antes de confirmar un pedido. Cuando ocurren errores, tienden a ocurrir al principio del proceso, generalmente dentro de los primeros minutos, y están vinculados a solicitudes específicas de la aplicación que el AI no puede manejar automáticamente.

Casos de uso prácticos demostrados

Los probadores intentaron varios escenarios. Uno involucró pedir un combo de teriyaki de pollo, donde Gemini agregó correctamente dos porciones de media porción después de interpretar el diseño del menú. Otro escenario programó un viaje al aeropuerto en función de una entrada del calendario. Al acceder a los datos de correo electrónico y calendario, Gemini identificó los detalles del vuelo, sugirió horarios de partida adecuados y configuró una reserva de Uber después de la confirmación del usuario.

Implicaciones para los asistentes móviles del futuro

La experiencia subraya que las aplicaciones móviles actuales, diseñadas principalmente para la interacción humana, no están optimizadas para el control de la inteligencia artificial. El enfoque basado en la razón de Gemini destaca la necesidad de que los desarrolladores adopten métodos de integración más robustos, como el Protocolo de Contexto de Modelo (MCP) o las funciones de la aplicación de Android, que proporcionarían interfaces de datos más limpias para los agentes de inteligencia artificial.

Perspectiva de la industria

Sameer Samat, jefe de Android de Google, señaló que el método actual de Gemini es una solución provisional que aprovecha la razón mientras que otras técnicas de integración maduran. Los observadores ven la beta como una visión previa de lo que los asistentes móviles impulsados por la inteligencia artificial podrían ser una vez que las aplicaciones estén diseñadas con la compatibilidad de la inteligencia artificial en mente.

Conclusión

Mientras que la automatización de tareas de Gemini todavía es lenta, ocasionalmente propensa a errores y limitada a un puñado de servicios, demuestra un asistente de inteligencia artificial funcional capaz de navegar aplicaciones del mundo real. Las limitaciones de la función señalan un desafío más amplio de la industria: rediseñar las interfaces de las aplicaciones para servir mejor a los agentes de inteligencia artificial. Si los desarrolladores adoptan protocolos más nuevos, las versiones futuras de Gemini podrían proporcionar una experiencia de asistente móvil más fluida, rápida y confiable.