Anthropic Lanza Modo Incógnito Gratuito para Claude AI

Puntos clave

- Modo incógnito gratuito ahora disponible para todos los usuarios de Claude.

- Las conversaciones incógnitas se excluyen del historial y la memoria a largo plazo.

- Solo se aplica un período de retención de seguridad temporal de 30 días.

- Las funciones de memoria siguen limitadas a los planes de Equipo y Empresa.

- La memoria permite a Claude retener el contexto, notas y preferencias entre sesiones.

- Las funciones incógnita y memoria operan de forma independiente, brindando a los usuarios opciones claras.

- Anthropic resalta la transparencia con iconos y etiquetas de incógnito visibles.

- La función diferencia a Claude de rivales como ChatGPT y Google Gemini.

Anthropic ha introducido un modo incógnito gratuito para su chatbot Claude, que permite a los usuarios de cualquier nivel de suscripción, incluido el nivel gratuito, realizar conversaciones privadas y no guardadas. Cuando se activa, las conversaciones desaparecen del historial y no se retienen en la memoria a largo plazo de la IA, con solo un período de retención de seguridad temporal de 30 días. Esta función complementa el nuevo sistema de memoria de Claude, que sigue limitado a los planes de Equipo y Empresa y permite al bot recordar el contexto entre sesiones. Al separar la privacidad y la memoria, Anthropic busca dar a los usuarios un control claro sobre lo que la IA recuerda, posicionando a Claude contra rivales como ChatGPT de OpenAI y Google Gemini.

Modo Incógnito Amplía Opciones de Privacidad para Todos los Usuarios

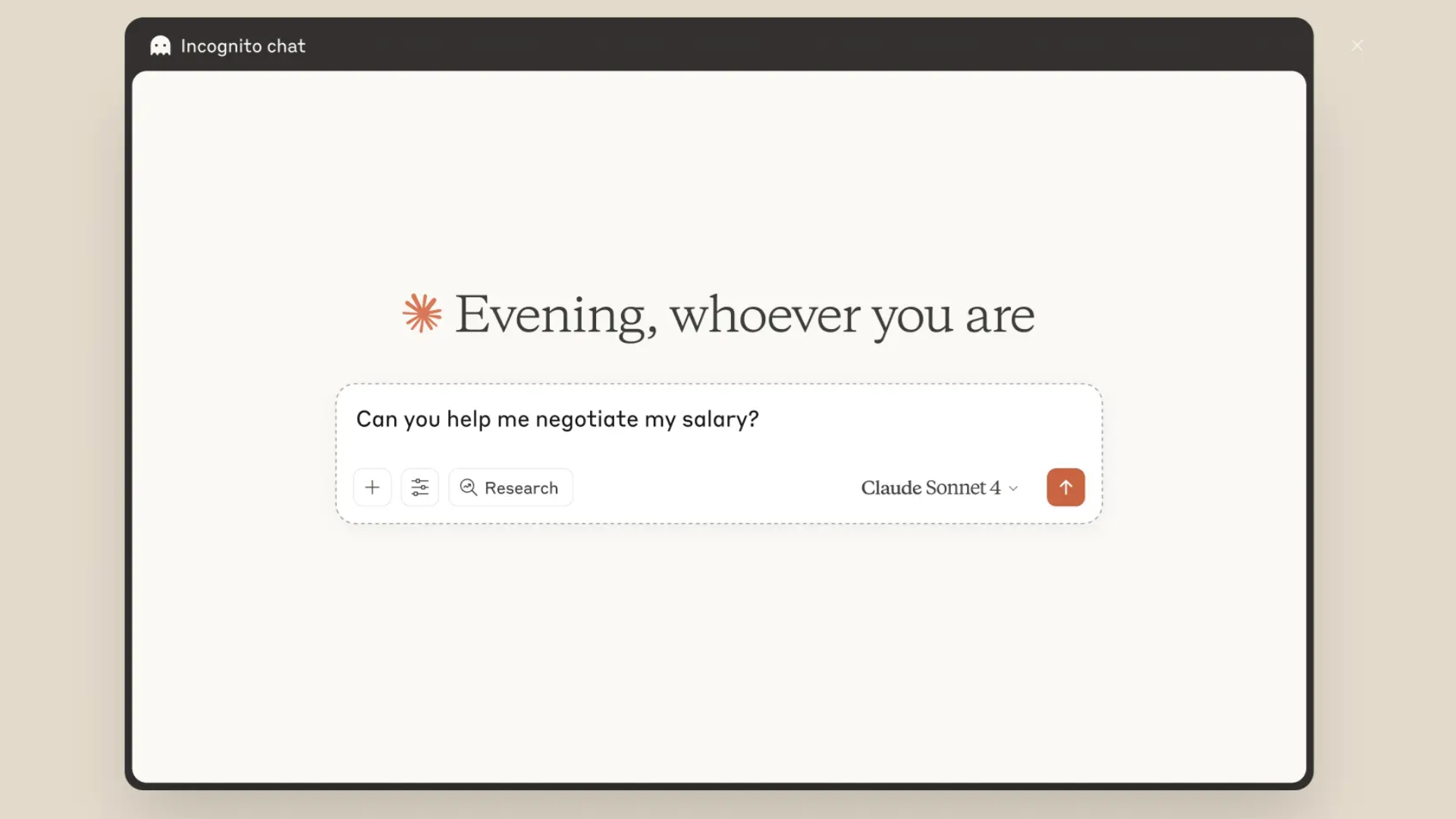

Anthropic ha lanzado un nuevo modo incógnito para su chatbot Claude que está disponible para todos los usuarios, independientemente del nivel de suscripción. Cuando un usuario hace clic en el icono de fantasma al inicio de una conversación, la conversación se marca como incógnita, indicada por un borde negro y una etiqueta. En este modo, el diálogo se omite del historial de chat del usuario y no se almacena en la memoria a largo plazo de Claude. La única retención es un período temporal de 30 días mantenido por razones de seguridad, después del cual los datos se eliminan.

Funciones de Memoria Permanecen Separadas

El sistema de memoria más amplio de Claude, recientemente introducido para los suscriptores de Equipo y Empresa, permite a la IA retener el contexto entre múltiples interacciones, almacenar notas específicas de proyectos y recordar preferencias de usuario. Esta memoria está aislada por proyecto, asegurando que las conversaciones relacionadas con el trabajo no se mezclen con conversaciones personales. El modo incógnito no interfere con estas capacidades de memoria; más bien, ofrece una alternativa de limpieza cuando los usuarios prefieren no tener persistencia.

Equilibrando Privacidad y Continuidad

La coexistencia del modo incógnito y las funciones de memoria brinda a los usuarios un control granular sobre sus datos. Los usuarios pueden elegir el modo incógnito para consultas exploratorias o sensibles, sabiendo que la conversación desaparecerá después de la sesión. Cuando se desea continuidad, como rastrear un proyecto largo, los usuarios pueden habilitar la memoria, lo que permite a Claude retomar donde lo dejó. Este enfoque dual refleja herramientas de privacidad familiar de los navegadores web mientras las extiende a la IA conversacional.

Paisaje Competitivo

El movimiento de Anthropic resalta un énfasis creciente en la privacidad en los servicios de chat de IA. Si bien ChatGPT de OpenAI y Gemini de Google también ofrecen opciones de chat privado y funciones de memoria, Anthropic se distingue al ofrecer el modo incógnito de forma gratuita en todos los niveles y al etiquetar claramente el estado de privacidad de cada conversación. Esta transparencia busca reducir la barrera para los usuarios curiosos sobre la IA pero cautelosos con los rastros de datos.

Implicaciones para los Usuarios

El modo incógnito fomenta la experimentación, permitiendo a los usuarios hacer preguntas poco convencionales o personales sin temor a que la IA retenga esa información. También sirve a los profesionales que necesitan un espacio de prueba para brainstorming sin llenar la memoria de proyectos a largo plazo. Al proporcionar tanto privacidad como memoria como herramientas separadas y opcionales, Anthropic posiciona a Claude como un asistente flexible adaptable a una amplia gama de casos de uso.