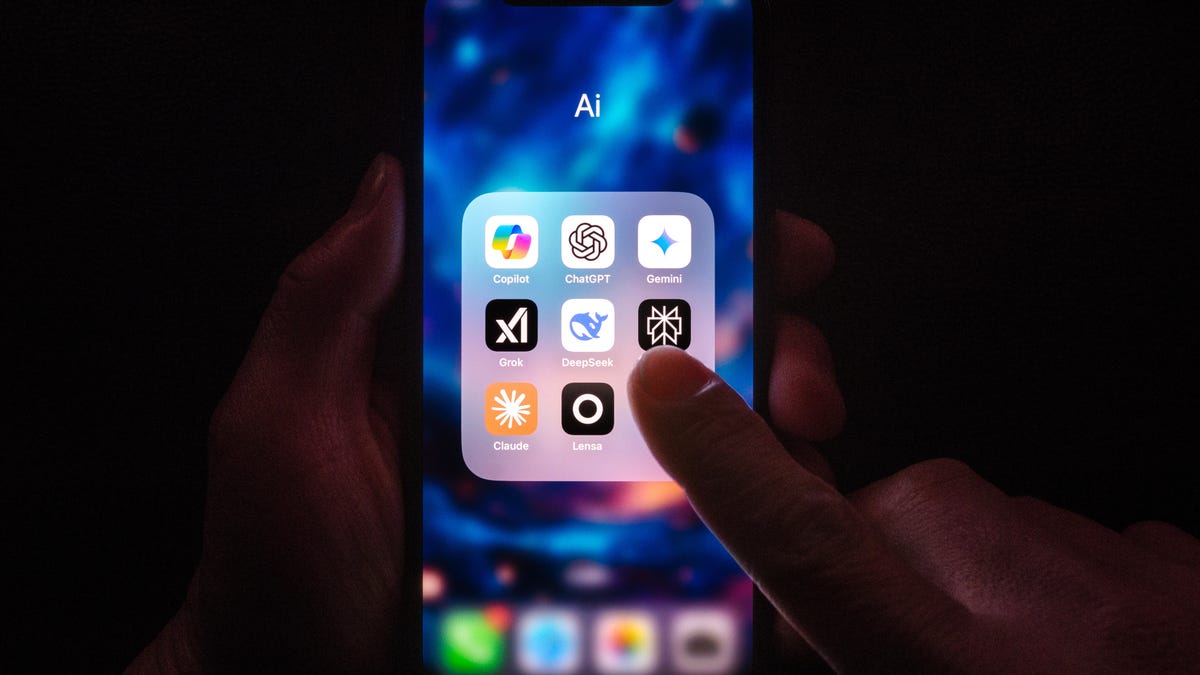

11 Situaciones en las que Usar ChatGPT Puede Tener Consecuencias Negativas

Puntos clave

- ChatGPT puede ayudar a organizar información de salud pero no reemplazar un examen médico.

- Ofrece consejos de salud mental pero carece de licencia profesional y empatía.

- En emergencias, use medidas de seguridad del mundo real, no consejos de chatbot.

- La orientación financiera y de impuestos debe provenir de contadores calificados.

- Nunca introduzca datos confidenciales o regulados en el modelo.

- Usar la IA para tareas de fraude o actividades ilegales está prohibido.

- Para noticias en tiempo real, confíe en transmisiones en vivo en lugar del chatbot.

- Las predicciones de apuestas de ChatGPT son poco confiables.

- Los documentos legales necesitan revisión de un abogado; la IA no es un sustituto.

- El arte creado por la IA no debe ser reclamado como obra humana original.

ChatGPT es excelente para redactar preguntas, traducir jerga y ofrecer explicaciones básicas, pero no es adecuado para diagnosticar condiciones de salud, brindar apoyo a la salud mental, tomar decisiones de seguridad de emergencia, manejar finanzas personalizadas o planificación de impuestos, procesar datos confidenciales o crear documentos con carácter legal. El modelo tampoco debe ser utilizado para tareas relacionadas con el fraude, el monitoreo de noticias en tiempo real, el asesoramiento sobre apuestas o la creación de obras de arte originales. Se recomienda a los usuarios tratar la IA como una herramienta complementaria en lugar de reemplazar a los profesionales en estas áreas de alto riesgo.

El Diagnóstico de Salud No Es una Especialidad de ChatGPT

Aunque el modelo puede ayudar a los usuarios a organizar cronogramas de síntomas y traducir terminología médica, no puede examinar a los pacientes ni ordenar análisis de laboratorio. Confiar en sus sugerencias para diagnósticos puede llevar a graves malinterpretaciones, que van desde afecciones menores hasta condiciones graves como el cáncer.

El Apoyo a la Salud Mental Requiere Empatía Humana

ChatGPT puede compartir técnicas de grounding, pero carece de experiencia vivida, señales de lenguaje corporal y licencia profesional. En crisis, los usuarios deben contactar a terapeutas calificados o líneas de ayuda de emergencia en lugar de depender de la IA.

Las Decisiones de Seguridad de Emergencia Deben Ser Inmediatas

El sistema no puede detectar peligros como el monóxido de carbono o el fuego, ni puede llamar a los servicios de emergencia. En situaciones urgentes, los usuarios deben evacuar y marcar el 911 antes de consultar cualquier chatbot.

La Planificación Financiera y de Impuestos Es Demasiado Compleja

ChatGPT puede explicar conceptos como los ETF, pero no tiene acceso a la renta, deducciones o tasas de impuestos actuales de un individuo. Los contadores profesionales siguen siendo esenciales para obtener asesoramiento personalizado y preciso.

Los Datos Confidenciales y Regulados No Deben Compartirse

Introducir comunicados de prensa bajo embargo, registros médicos o cualquier dato protegido por leyes de privacidad riesgos la exposición, ya que el procesamiento de la IA se realiza en servidores externos. Los usuarios deben tratar el modelo como cualquier plataforma pública y evitar cargar información sensible.

Las Actividades Ilegales Están Fuera del Ámbito del Modelo

Cualquier solicitud para facilitar comportamientos ilegales está explícitamente desaconsejada.

La Integridad Académica Se Ve Comprometida por el Trabajo Generado por la IA

Aunque ChatGPT puede servir como una herramienta de estudio, utilizarlo para producir ensayos o respuestas de exámenes constituye fraude y puede llevar a acciones disciplinarias.

Las Noticias y Datos en Tiempo Real Requieren Fuentes Dedicadas

Aunque el modelo puede recuperar páginas web frescas, no transmite actualizaciones continuas. Para información crítica con respecto al tiempo, los usuarios deben confiar en transmisiones en vivo y lanzamientos oficiales.

El Asesoramiento sobre Apuestas Es poco Confiable

La IA puede generar estadísticas de jugadores o informes de lesiones, lo que la hace inadecuada para decisiones de apuestas.

Los Documentos Legales Exigen Redacción Profesional

ChatGPT puede esbozar conceptos legales básicos, pero redactar contratos, testamentos o fideicomisos sin supervisión de un abogado riesgos la no conformidad con las leyes específicas del estado.

La Creación Artística Debe Permanecer Impulsada por Humanos

Aunque la herramienta puede generar ideas, producir arte original para hacerlo pasar como trabajo personal es desaconsejado.

En general, la recomendación es tratar a ChatGPT como un recurso auxiliar para tareas de bajo riesgo y consultar a profesionales calificados para cualquier decisión de alto riesgo.