El enfrentamiento de Anthropic con el Pentágono sobre la política de uso de la IA

Puntos clave

- El modelo Claude de Anthropic está vinculado a un contrato de $200 millones del Pentágono que incluye una política de uso responsable.

- El Pentágono busca una cláusula de "cualquier uso legal", ampliando las posibles aplicaciones militares.

- Anthropic se niega a apoyar armas letales autónomas y vigilancia masiva domestica.

- La designación como un riesgo en la cadena de suministro podría terminar el contrato y obligar a los contratistas a abandonar Claude.

- Otras empresas de IA ya han renegociado sus contratos con el Pentágono para alinearse con las demandas de uso más amplias.

- El conflicto destaca la tensión entre la adopción rápida de la IA para la defensa y las políticas éticas corporativas.

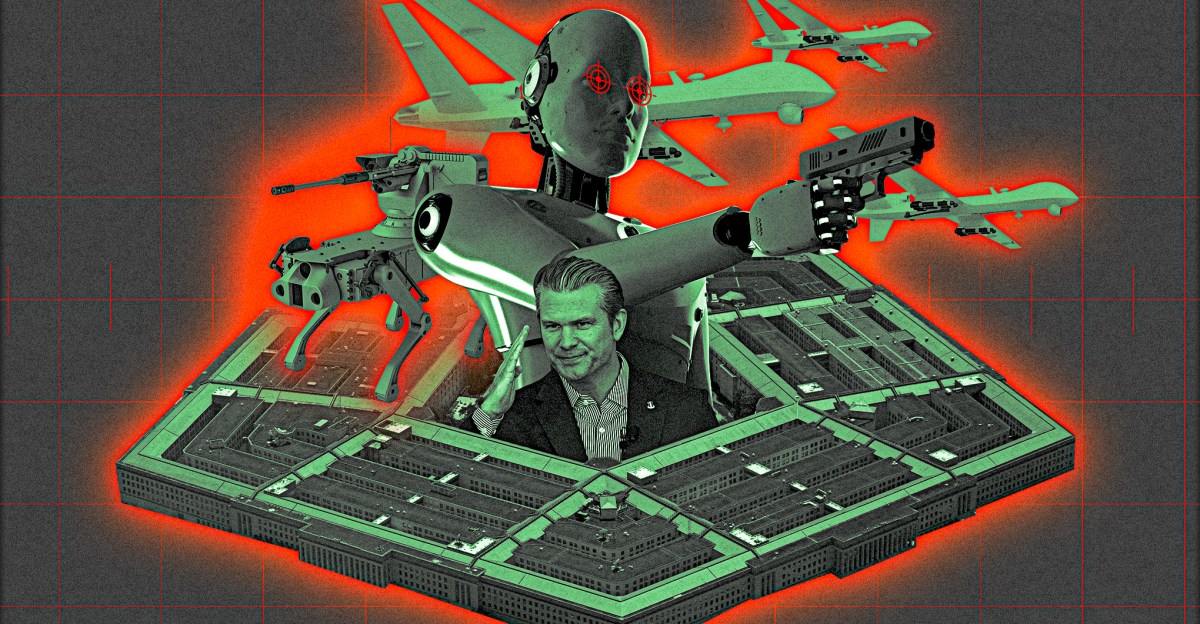

Anthropic, la startup de IA detrás del modelo Claude, se encuentra en una disputa de alto riesgo con el Departamento de Defensa de los Estados Unidos. El Pentágono quiere un uso sin restricciones, "cualquier uso legal" de la tecnología de Anthropic, mientras que la empresa se niega a apoyar armas letales autónomas y vigilancia masiva domestica. El desacuerdo amenaza un contrato de $200 millones y podría obligar a los contratistas de defensa a abandonar los modelos de Anthropic. El choque destaca la tensión entre la adopción rápida de la IA militar y las políticas de uso responsable corporativas.

Antecedentes

Anthropic, conocida por su modelo de IA Claude, firmó un contrato de $200 millones con el Departamento de Defensa el año pasado. El acuerdo incorpora la "política de uso aceptable" de la empresa, que prohíbe el uso de su tecnología para operaciones cinéticas autónomas y vigilancia masiva domestica.

Posición del Pentágono

El Pentágono, liderado por el subsecretario de Defensa para Investigación y Ingeniería Emil Michael, está presionando para incluir una cláusula de "cualquier uso legal" que daría a los militares carta blanca para emplear los servicios de Anthropic en cualquier capacidad, incluyendo la vigilancia masiva y las armas letales autónomas.

Líneas rojas de Anthropic

Anthropic ha dejado claro que no cumplirá con solicitudes que contradigan su política. La empresa cita directivas existentes del DoD que requieren juicio humano en el uso de la fuerza y prohíben la recolección de inteligencia sobre personas de los Estados Unidos sin autoridad legal específica.

Consecuencias potenciales

Si el Pentágono clasifica a Anthropic como un riesgo en la cadena de suministro, el contrato de $200 millones podría ser terminado y los contratistas de defensa que dependen de Claude podrían ser obligados a eliminar la tecnología de sus sistemas. Esto tendría un efecto dominó en toda la industria de defensa, que actualmente utiliza el modelo de Anthropic para trabajos clasificados.

Reacción de la industria

Otras empresas de IA como OpenAI, xAI y Google ya han renegociado sus contratos con el Pentágono para alinearse con el lenguaje de "cualquier uso legal". Sin embargo, la postura de Anthropic ha generado críticas y apoyo de varios trabajadores de tecnología y expertos en políticas, subrayando el debate más amplio sobre la implementación responsable de la IA en contextos de seguridad nacional.